Nvidia Research������һ�������κ�3Dѵ�����ݼ���Ԥ��2Dͼ���3D���Ե�AIϵͳ����������ڹ�������Ϣ����ϵͳ����Ȼ����Ͻ��н��ܣ��ڸû����ϣ�ѧ�������ҵ���о���Ա���������µ�ǰ�ػ���ѧϰ�����������ǵ�33�꣬��ǰ��ΪNIPS�Ļ��齫�ڱ����ڼ��ô��¸绪���С�NeurIPSӵ�г���13,000�������ߣ���һ��������AI�о����顣

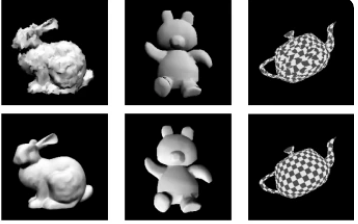

����������Զ����ѧʸ���о�����Ӣΰ���о���˾�Ͱ����д�ѧ���о���Ա���У���“ѧϰ���ʹ�û��ڲ�ֵ�Ŀ�����Ⱦ��Ԥ��3D����”�н�������ϸ���ܡ���һ����Nvidia��AI���ܺ����ĵĹ�ͬ����Sanja Fidler�ڽ��ܵ绰�ɷ�ʱ����VentureBeat���ù�˾������ͼ�������ֵ���Ⱦ���(DIB-R)��չ�������ӵ���������Ϊ������������������Ⱦ3Dģ�͡� ����������ܻ�����Ϸ��AR / VR�������˻�������ϵͳ�еõ�Ӧ�á�

“����һ�£�����������һ����Ƭ��Ȼ�����һ��3Dģ�ͣ�����ζ�������ڿ��Բ鿴��[����]��ͬ�Ƕ���������Ƭ�ij�������˵��“������DZ�����У��Ӳ�ͬ�ǶȲ鿴��–����������Ƭ�����������Ƭ��Ȼ�����DZ��3D������Ȼ�������Ƕ�һ��������м�飬”��˵��

�Ѿ�����������3D��Ʒ�е����ѧϰ��Facebook AI Research��Google��DeepMindҲ�Ѿ�ʵ����2D��3D AI������DIB-R������������ѧϰ�ܹ�֮һ����������2Dͼ��Ȼ��Ԥ�⼸���ؼ���3D���ԣ�������״��3D���κ���ɫ�Ƶ���˵��������ʵغ��ʵء�